一首歌是怎么创作的?人工智能续写的贝多芬的交响乐有“那味儿”吗?音乐的特殊性与复杂性体现在哪里?东方的诗画也活在音乐里?我的普通话说得不好,会影响唱歌吗?音乐和方言有啥关系?我学过点乐理,但人工智能是怎么听懂音乐的?我没学过音乐,能不能让人工智能帮我写首自己的歌呀?本期内容带大家一起揭开音乐人工智能的神秘面纱。

科学技术促进音乐发展

2021年是伟大的作曲家贝多芬诞辰250周年,在这样一个特殊的年份中,世界各地都组织了很多音乐会去纪念这位伟大的作曲家。在贝多芬身上,我们看到的是他用悲伤的人生谱写欢乐的乐章,他永远是那么的激情,对生活充满了向往和憧憬。其中,人工智能界和音乐界一起联手做了一件事,就是由美国格罗斯大学的艾哈迈德•埃尔加迈尔先生带领团队,对贝多芬的第十交响曲进行了续写。

2021年的这样一部用AI续写的音乐作品,是科学技术对于音乐创作的一个尝试。从科技对乐器的发展影响来看,每次新技术与新思潮的出现,都对音乐行业产生了极大的影响。自工业革命以来,从生产方式来看,新兴的资产阶级对艺术的渴望,促进了音乐家的创作热情,音乐家不再附庸于贵族,而是为创造出新的音乐,以满足音乐爱好者和满足不同的听众为己任。科技对音乐创作的本体也产生了巨大的影响。在第一次工业革命发生后,法国大革命对18、19世纪的欧洲产生了巨大的影响,如果用理性来代表18世纪,那19世纪就是突破理性,欧洲艺术家在中世纪文艺复兴、巴洛克时期、古典主义时期积累的所有情感与想法在19世纪都迸发出来。浪漫主义时期音乐在时代的影响下,也具有了其独特的风格特征。

机械化的新材料对乐器制作工艺的升级提供了基础。比如有很多电声乐器,像电吉他、电贝斯等都对演出带来了新的音响效果。

科技对乐器发展的影响

作为乐器之王钢琴,“施坦威”品牌的钢琴对于学琴的孩子来说不会陌生。“施坦威”钢琴在它自己的这个领域也进行了科技上的拓展,比如自动演奏部分,最新的“施坦威”spirio系统,不仅可以自动演奏大师水准的录制作品,而且可以做到异地同时演奏,消除了以往网络传输所带来的在合奏中非常令人头疼的延迟问题。可以想象,如果你在北京,你的合作伙伴在上海或者广州,双方可以在同一时间同一节点上合奏同一作品的同一乐章、同一小节,这样的学习和合作相信会对未来的演出和音乐教育产生巨大的影响。

音乐人工智能的特点

1.音乐的特殊性音乐人工智能首先要尊重音乐的特殊性。音乐是最具抽象的艺术形式之一,艺术有很多种形式,在这些艺术形式中间,戏剧是最广受喜欢的一种艺术形式,比较直观,绘画往往是在一个历史时期产生思潮变化的一个最终的体现形式,而音乐往往是在这两种艺术形态都发生了巨大变化之后才会有一些影响。音乐的这种抽象性,只有时间的流逝才是检验他的唯一的标准。同学们是不是也能记忆起你儿时最喜欢的歌谣呢,在童年歌谣的回忆中还有多维度多层次对于家庭温暖的回忆吧?

传统的音乐学习更依赖于老师的口传心授,音乐的灵感是可遇不可求的。是不是人人都可以作为音乐的创作者呢?这问题在音乐的特殊性里面其实就有所体现,因为音乐的创作是在你有一个乐思后,还需要大量的艺术修养方面所积累的音乐技术,来帮你解决如何从一个灵感一个乐思到一首曲子的过渡。而这样的创作技术往往不是每一个人所能够掌握的。

以上音乐的这些特殊性,对传统的深度学习的基本范式提出挑战。在传统的深度学习中,往往需要通过大量的数据去处理一些特定的、具体的任务,泛化和推广能力不足。对于音乐而言,我们每个人本身就是一个个独立的个体,在人的精神属性和积累之下,艺术创作更加绚烂多彩、不拘一格,导致个性化和特异性的问题很多。

此外,在我们用大数据去处理一些特定任务的时候,往往不能够像人类那样针对特定任务去真正地思考、理解和消化,从而得出一种更加符合逻辑的推理方式。

第三个可能存在的问题是如何对音乐的这种解释性进行探索。我们往往在做音乐史的这种宣讲或者是教育的时候会问同学,这一首音乐你听到大海的声音吗,或者说是作曲家在音乐创作的时候,会有这样的一种解释性。无论是作曲家还是音乐学家的这种解释,对于我们传统的深度学习提出了很大程度的挑战。

音乐领域相对于图像领域、金融领域来说,没有像别的领域那么多的标注好的数据,可能无法满足深度学习的需求。在这样的一个背景下或者思考下,音乐作为人类和人工智能之间的桥梁,是否可以启发我们对于下一代人工智能技术的一些思考。对于像艺术类的这种小数据领域,是否能借助于人工智能创作出五彩斑斓的音乐,创作出我们想象中的声音世界呢?

2.音乐的复杂性

音乐的另外一个特性是音乐的复杂性,类似于复杂系统,复杂系统一般有四个特征:海量数据(Numerosity)、相互依赖性(Interdependent)和非线性(Nonlinearity)、联通性(Connectivity)、Autonomy(自治)and Adaptation(自适应性)。

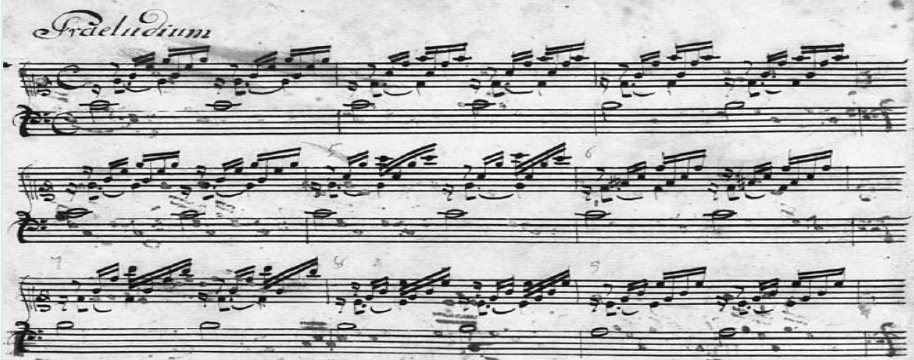

音乐领域曾经做过一系列的实验。比如扫描大脑在听音乐时候的反应,会发现这种在仪器中的运动和音乐,所表达的情感体验,脑波具有无标度性,类似于数学混沌与分型理论中的无标度性,我们看到每一片雪花、每一朵浪花,其实都是不一样的,这种不一样和无规则性,其实就是一种无标度性的体现。无标度性是指在具有分形性质的物体上任选一局部区域,由于其自身具有自相似性,对它进行放大后,得到的放大图形会显示出原图的形态特性,即它的形态、内在的复杂程度、不规则性等各种特性,与原图相比均不会发生变化。比如巴赫的C大调前奏曲,也具备音乐强度的无标度性,并且它的旋律、音程符合分型的分布,节奏与音程都具有标度的无关性,所以像这样的一些跨学科的研究可以给我们更好的机会去认识、学习和理解音乐。

巴赫乐谱呈现的无标度性

什么是音乐人工智能

音乐人工智能还是人工智能音乐是不同侧重的两个方向,人工智能音乐是以人工智能技术为主,解决音乐领域的问题;而音乐人工智能是用音乐领域的思想或者创作方法去启发人工智能技术的发展。

当下本项目组在做的音乐人工智能生成,是将通用人工智能应用于音乐的建模、分析、生成与评价等,将音乐人工智能的模型价值观与人类的价值观对齐。也就是说,将生成一种更可控、更具可解释性的音乐人工智能的方案。

音乐人工智能的研究方向

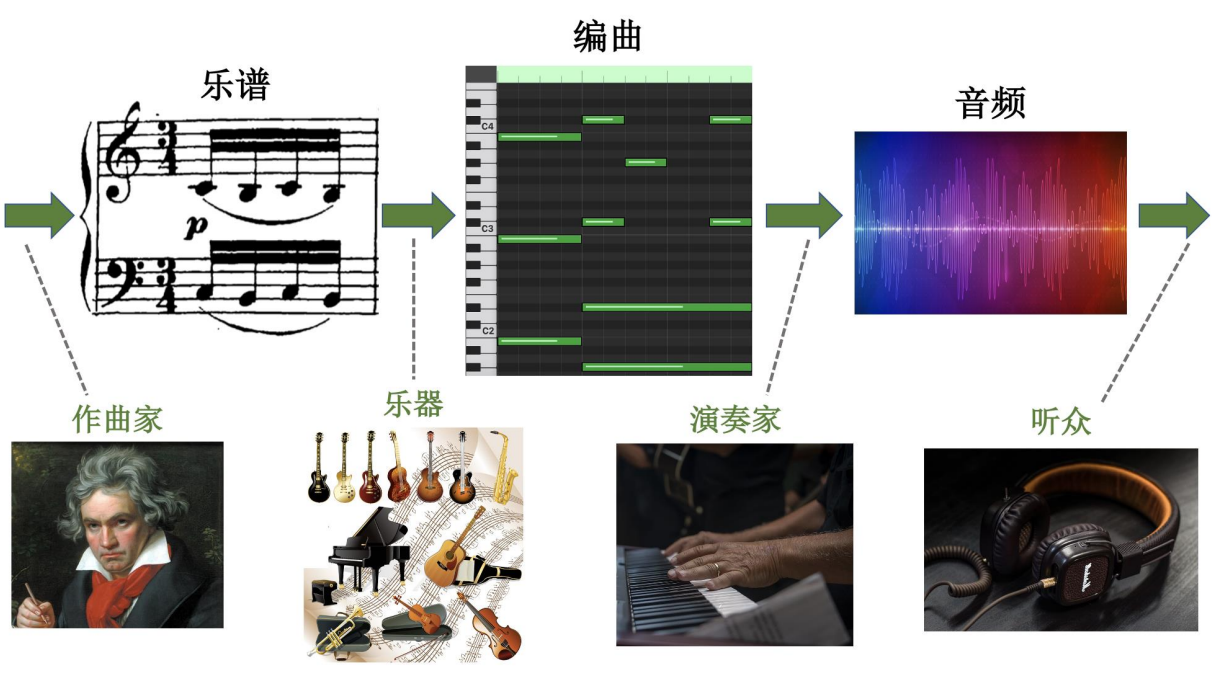

人类创作音乐是一个数百年的积累,音乐创作过程体现了人类的文明之光。以一首歌的创作为例,说明人类创作音乐的过程。作曲家在一开始往往会涌现出一个小小的浪花,也就是一个小小的乐思;然后,作曲家根据长期学习训练所掌握的作曲理论知识和作曲技术,把乐思扩展为一部作品。

人类创作音乐的过程

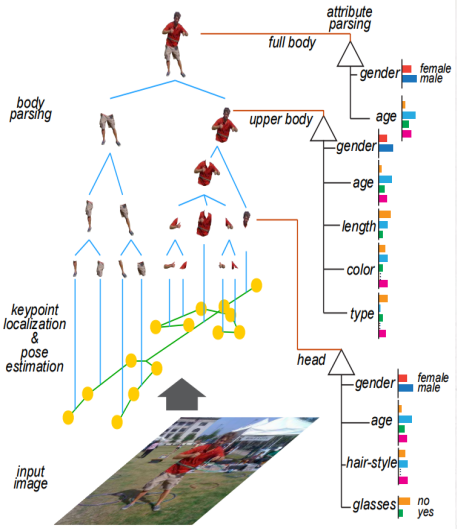

目前本项目组模仿人类音乐创作过程,基于朱松纯教授的使用与或图(And Or Graph,AOG)表示模型对音乐结构进行解析。在视觉领域对图像的解释,比如右图上面是一个人的图像,在计算机视觉中AI能够解译出人的前景和背景,进而将人分解成上半身和下半身,而上半身还可以进一步的分解出头和肩颈、躯干等。经过一步步的分解,就形成了一棵解析树,在这棵树上面每一个节点都有相应的属性。比如一个人脸大概是多少岁,是男生还是女生,比如头部的这个节点就可以看到足够多的属性,头发是多是少,眼睛是大是小,这些都是属于这个人的特定属性。

人体的与或图

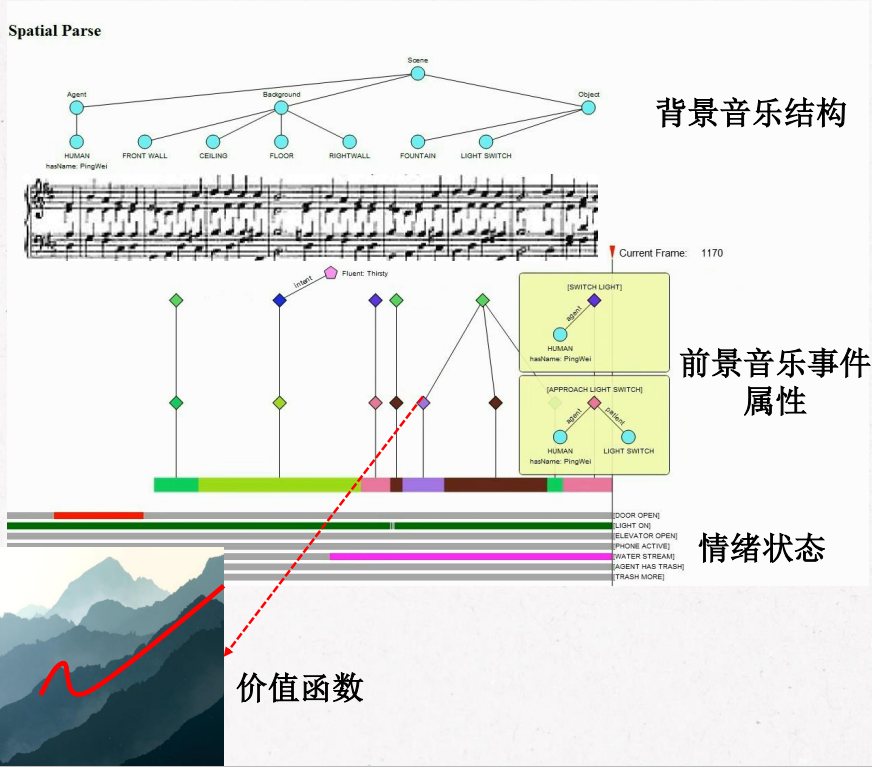

将与或图应用到音乐里面,可能就是将音乐的前景事件与背景结构解析出来,也可以通过分析某一节点的情绪状态,进行这一个音乐上的更多解析。比如,观察一个山景的时候,可以看到它的前景,也可以看到背后的远山。在音乐里面,往往可以观察到小提琴的声音是非常的清晰悦耳,后面背景无论是定音鼓或者是其他的交响乐,所构建出来的远山美景,更加突出了小提琴或者是钢琴或者是独奏乐器的这种Solo片段的唯美与清晰。

音乐结构的与或图

有前有后,纵观全身。从某种意义上讲,交响乐的布局更加符合AOG理论。例如这段音乐,可以解译出从乐段、乐章、乐节、音型一直到音符的层次结构,并且能够计算出每个音型的中心音、乐节的旋律包络,统计音高与音程以及音乐的调性等音乐元素。

有前有后,纵观全身。从某种意义上讲,交响乐的布局更加符合AOG理论。例如这段音乐,可以解译出从乐段、乐章、乐节、音型一直到音符的层次结构,并且能够计算出每个音型的中心音、乐节的旋律包络,统计音高与音程以及音乐的调性等音乐元素。

即使同学们没有学过复杂的乐理,通过这样的解析方式,我们也可以对这一段音乐有比较直观的解析和了解。

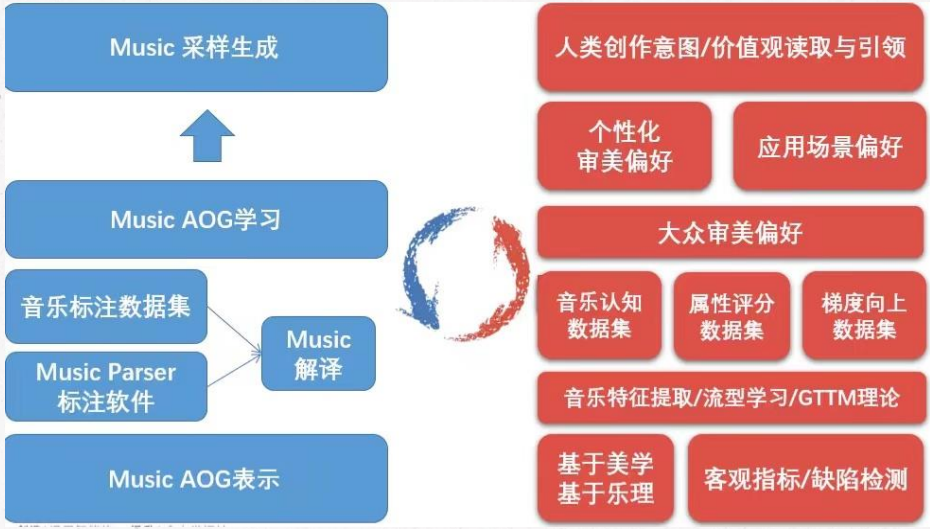

除了AOG的解译理论之外,音乐人工智能还有一个非常重要的理论基础,音乐UV理论。左边的部分代表U,表示通用人工智能对于音乐的表示、学习、解译、采样、生成等功能;右边的这一部分V,代表的是音乐的价值函数的研究,包含了乐理、审美、人类价值观对齐等研究。所谓的人类价值观的对齐,就是如何让机器懂得人类的情感,让机器与人类的情感的表征保持一致,用机器之心对齐人类之心。

音乐UV理论

音乐人工智能的美学基础

1.认知音乐学

创作一个音乐的美学基础是什么。除了传统的作曲的四大件之外,一些传统乐理的作品分析手段,随着音乐学领域的发展出现的一些新的理论,比如认知音乐学。通过认知音乐学去思考人们对于音乐的反应。认知音乐学更像是在解析人类对于音乐创作和聆听的初心,里面用到了大量的新技术手段,比如脑扫描等。所以,认知音乐学是一门多学科交叉融合的学科。

这里首先讨论一下中国的传统美学思路。在东方的审美习惯里面,经常将通感作为一种重要的审美标准通感,比如苏轼对王维的作品评价:“味摩诘之诗,诗中有画;观摩诘之画,画中有诗”。我们古人不是用一种艺术形式来体会美、感受美,而是从更多的维度去审视美、认知美。我们不仅有听觉,还会把听觉形象转化为视觉形象。

在艺术创作中除了对传统美学思想的继承发扬,还有一种对于先贤精神的传承及致意。比如某一部作品是向某位先贤或者前辈艺术家的致敬。比如勃拉姆斯是古典音乐的发展史上一位非常重要的作曲家,他对贝多芬非常崇敬,他的第一交响曲被世人认为是贝多芬交响曲的一种再现,体现了勃拉姆斯对贝多芬交响曲的崇拜与传承。其中,对贝多芬的C小调特色风格的再现,对第九交响曲欢乐颂主题的重现,都体现了勃拉姆斯在他的时代对贝多芬的一种思念和崇敬。

2.音乐对人类的影响

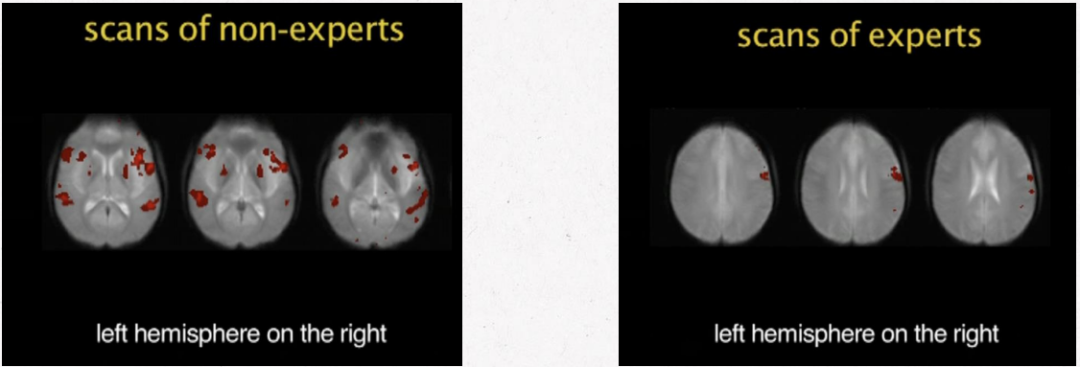

听音乐、演奏音乐都是大脑复杂的协同工作结果,长期的音乐训练也会对人的大脑产生影响,如下图所示就显示了歌唱家在歌唱时大脑区域活动得明显比未经训练的人活动区域要少。所以这些研究也启发了音乐帮助大脑受损的人进行功能恢复性训练,虽然过程漫长曲折。

专业人士与非专业人士唱歌时的大脑活动区对比

3.音乐对语言的影响

在人类的感官里面,音乐和语言之间存在着紧密的联系。比如有社会学家发现,在非洲某个部落人们在学习语言之前实际上是用音乐来传达对孩子们的教育的,也就是说,对于部落的所有知识和规则的传承,都是编成儿歌来传授给下一代的。这些部落没有文字,所以部落的所有传承都是依靠歌声、歌曲来进行的,音乐在当地承担着语言的重任。

美国作曲家伯恩斯坦曾在哈佛大学的讲座中明确提出,将乔姆斯基的语言学理论运用到音乐学之中,并且在“创作本体、民歌,符合母语节奏”的研究中发现,民歌的创作更为符合作曲家的母语节奏。比如,浪漫主义后期的民族乐派的作曲家们,像英国作曲家埃尔加•威廉姆斯,他的《威风凛凛进行曲》,有非常强的音节的抑扬顿挫,和英语听起来很像。再比如,我们听到法国的德彪西、圣桑作曲家的作品的时候,比如《月光》,非常梦幻。目前音乐与语言的相关性研究已经有很多音乐心理学领域的专家在研究,并取得了一定的成果。

通用音乐人工智能的技术展示

仅仅通过感性的认知还不足以确定一个科学观点,如何实现音乐人工智能是一个技术问题,我们提出了具体实现的技术路径。

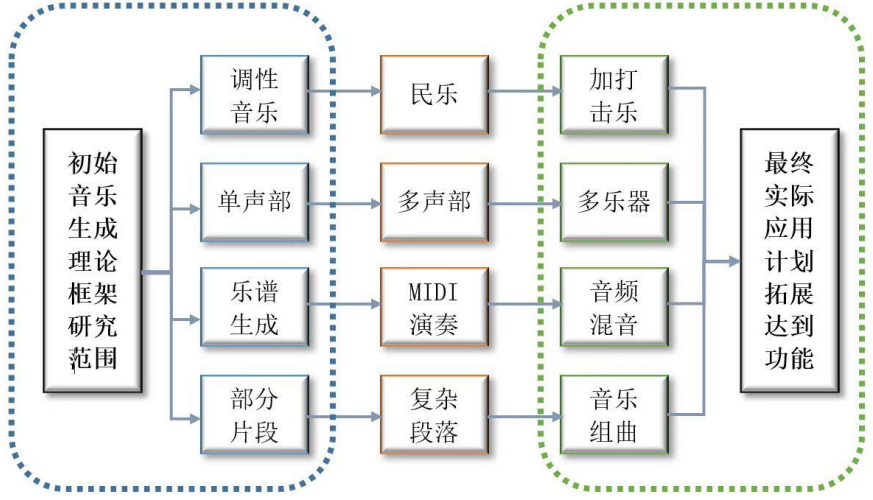

在技术路径里面,初始音乐生成理论框架研究范围,涵盖了调性音乐、单声部、乐谱生成部分片段这些内容,希望能够通过不同的方法从初始音乐生成理论框架的研究开始,一直达成最终的实际应用计划,拓展所达到的功能。比如,在做调性音乐的时候,再做一些民乐,然后加入一些打击乐。第二步在做单声部音乐的时候,我们希望能从单声部发展到多声部,并且进入多乐器。然后,在架构里面希望能够有乐谱生成,进而MIDI演奏和音频混音。前面的工作都完成之后,希望能够由部分的片段生成复杂的段落,再到音乐的组曲生成,最终实现从乐谱生成到MIDI生成,一直到音频生成这样的技术路径。

未来音乐人工智能的发展趋势

未来音乐人工智能将会怎样发展,我们设想了音乐人工智能发展的一些应用场景。音乐人工智能的商业场景,例如音乐社交,也可以帮助一些媒体或者是一些商业用户进行引流,提高用户的体验值,比如在养老社区开展各种乐器的学习,组建一些合唱团,让人们用音乐去传情达意。此外,还可以对不同的人群进行音乐推荐。

未来会有一些音乐人工智能的产品出现。包括一些在线音乐、穿戴式音乐治疗以及在音乐教育、音乐演出、音乐生成、音乐技能评测、声音的合成以及修正、跨模态的音乐生成以及音乐的人机交互等方面,都会有非常大的一个应用前景。

具体的音乐人工智能应用,可以在游戏配乐里面经常找到。相信在未来几年,游戏配乐可能会大幅使用到音乐人工智能的技术。目前,短视频和广告配乐已经非常普遍,或多或少地都已经应用到这样的音乐技术。电影配乐由于其时长、视频解译等多方面影响,可能是未来长期的发展方向。音乐制造,是囊括专业的音乐生成、音乐创作、音乐演出、音乐表演以及音乐传播领域上面的长产业链,其生产方式也将会受到音乐人工智能的巨大影响。

来源: 艺科资讯

内容资源由项目单位提供

科普中国公众号

科普中国公众号

科普中国微博

科普中国微博

帮助

帮助

中国自动化学会

中国自动化学会