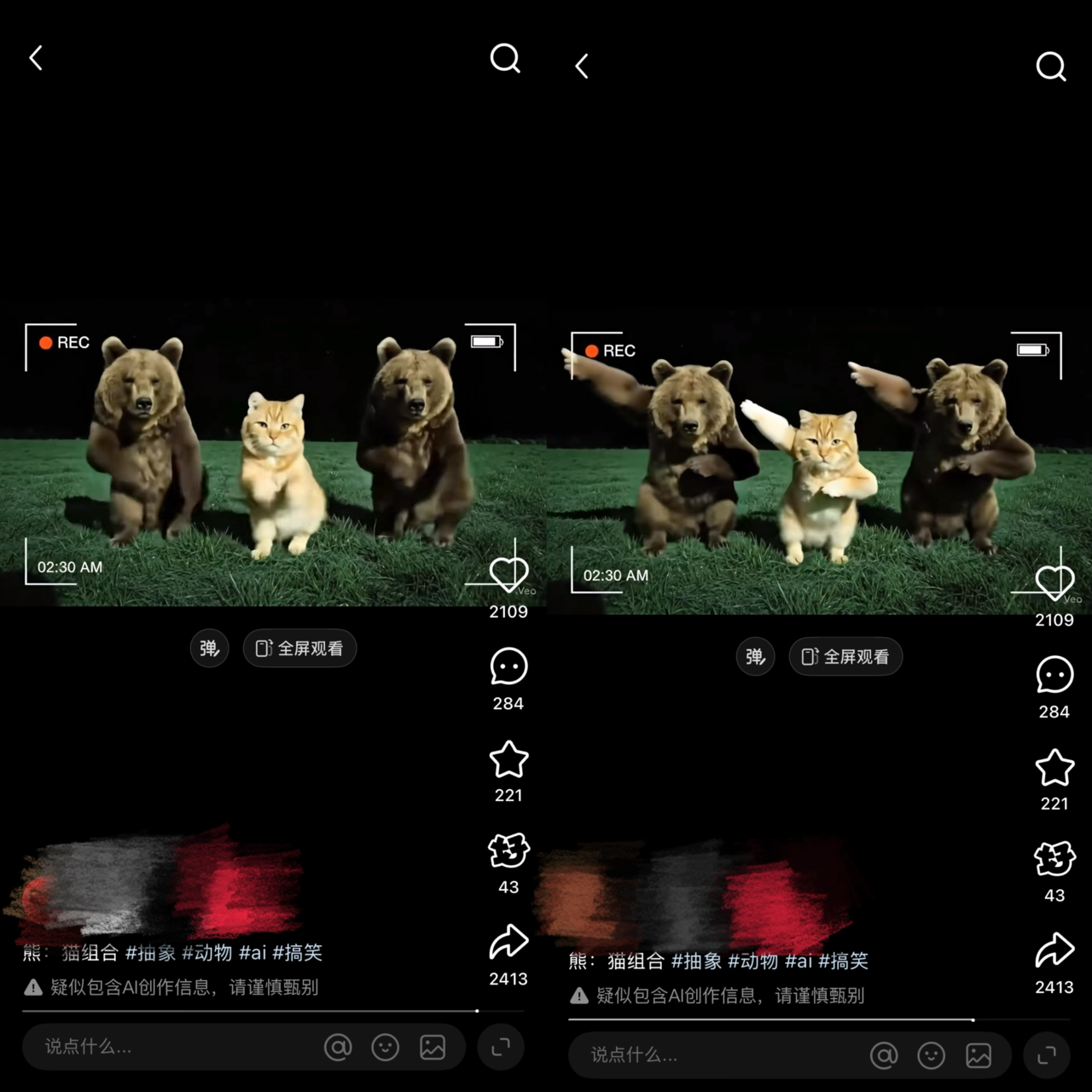

“疑似包含AI创作信息,请谨慎识别”,日前,记者在浏览某短视频平台时发现,一条短视频文案下方,被平台标注了这样的提示。

平台截图

这一“提示小字”上线,与一项新规的实施有关。9月,国家互联网信息办公室、工业和信息化部、公安部、国家广播电视总局联合发布《人工智能生成合成内容标识办法》(以下简称《标识办法》)正式开始实施。《标识办法》明确所有AI生成的文字、图片、音频、视频等内容都要添加标识。

那么,如何对AI生成内容进行标识?《标识办法》的施行会对行业、个人用户,以及相关技术的发展带来哪些影响?当前落地过程中,又面临哪些挑战和机遇?对此,潮新闻专访杭州电子科技大学网络空间安全学院,浙江-法国数字媒体取证联合实验室主任乔通。

“显式”+“隐式”,双重标识筑牢防线

在《标识办法》中提到,对于不同类型的AI生成内容提出明确标注要求,确保用户与监管方能够清晰识别AI属性。其中提到,人工智能生成合成内容标识包括显式标识和隐式标识。

“显式标识就像一个长‘Logo’。”乔通解释道,显式标识是指在生成合成内容或者交互场景界面中添加的,以文字、声音、图形等方式呈现并可以被用户明显感知到的标识。例如在AI生成视频角落添加“AI生成”字样,或在文本首尾标注生成来源,便于用户直观识别。

豆包AI生成

而隐式标识则更为隐蔽,需借助技术手段才能识别。以图像为例,像素之间存在大量肉眼无法察觉的冗余信息,隐式标识通过微调部分像素值,将标识信息嵌入这些冗余空间中,其技术本质是“信息隐藏技术”。

“一旦有人利用AI生成伪造视频或者图像等内容,并在互联网传播,隐式标识就像一把‘定位钥匙’,帮助快速追溯内容来源。”乔通进一步说明。

此外,《标识办法》要求在AI生成内容的文件内部嵌入元数据,且字段名称必须包含“AIGC”标识符号。

乔通指出,其实许多文档、图片、视频等内容本身都自带“元数据”,记录着创建时间、存储位置等基础信息,元数据标识就是在这些属性中,额外添加“内容由AI平台生成”的标注。

也就是说,即使没有明显标识,若该视频内容含有“隐式标识”,那也可以通过其背后的“元数据”进行溯源定位,这对被侵权人的合法权益具有重要意义。

平台纷纷响应,营造清朗网络空间

目前,各大AI平台均在积极响应《标识办法》,出台了各类细则。记者通过浏览多个平台的公告细则观察到,多个平台均按照要求,为AI生成内容添加了用户易感知的显式标识,明确其“AI身份”,对于未按规定添加标识的创作者及内容,平台也明确了相应惩罚措施。

DeepSeek公告截图

值得注意的是,腾讯、抖音、商汤等企业还明确公告,对AI生成元数据嵌入“隐式标识”,以方便内容信息溯源。

潮新闻注意到,《标识办法》中第十条明确规定,用户使用网络信息传播服务发布生成合成内容,应当主动声明并使用服务提供者提供的标识功能进行标识。

在乔通看来,一方面,对于各大平台,尤其是部分公众认知度较低的小众平台,《标识办法》相当于划定了“内容标注红线”,推动其运营更规范。同时,明确的AI标识能减少用户对“内容真实性”的困惑,间接提升整个网络空间的可信度。

另一方面,对于监管机构而言,标识溯源和取证更加便捷。以往,监管部门需委托第三方机构,通过复杂技术检测AI生成内容,耗时耗力。如今,借助AI标识,监管部门可独立快速识别和追溯源头,大幅降低人力物力成本。“这对于营造清朗网络空间是十分有利。”

标识并非“万能”,监管防控还需“多方合力”

《标识办法》正式实行刚满半月,但从落地实践上看,《标识办法》并不能彻底杜绝AI生成谣言、假消息的产生。

比如对于显性标识,用户可以删除相关文字及标识图形来去除;对于隐性标识,用户也可以通过转码等方式进行一定程度的规避。也就是说,基于标识的识别无法对于恶意用户发布的内容进行精准鉴别。

“要应对这一问题,首先需要提升大众的认知和警惕意识,提高自身的识别能力。”乔通建议,普通用户可通过一些细节判断内容真实性。

他举例道,如视频、图像上,公众可通过观察画面是否连贯性、有无异常抖动;在音频上,留意音色是否自然,语气是否符合日常交流的抑扬顿挫等。“若发现内容与日常认知存在偏差,逻辑或感官上‘别扭’,就需带着怀疑态度进一步核实,必要时借助专业工具检测。”

从技术方面,乔通表示,技术检测方要尽可能地让检测器“见多识广”,需用大量AI伪造数据对其进行优化,并针对视频、文本、音频等不同应用场景,调整检测器的识别算法,提升适配性。同时,平台方也需要不断更新技术手段,保护标识不被恶意去除。

标识是生成内容治理迈出的关键一步,但它只是多层次防控体系的一部分。乔通也表示,要真正规避风险,还需要细化法律法规,建立行业自律标准,加大执法力度等。